金磊 楊凈 發(fā)自 凹非寺

量子位 報(bào)道 | 公眾號 QbitAI

當(dāng)互聯(lián)網(wǎng)大佬們集體唱歌,會擦出怎樣的火花?

現(xiàn)在,火爆抖音的AI特效,一鍵就可以實(shí)現(xiàn)夢幻聯(lián)動。

瞧!馬云、馬化騰、馬斯克等大佬們,正在集體演唱神曲《螞蟻呀嘿》。

不光演唱,表情也是十分的賣力(傲嬌的小眼神很是傳神啊)。

完全看不出是被迫的樣子呢。(手動狗頭)

效果之魔性,引得網(wǎng)友直呼:

短短的幾秒,要用一生去治愈…..

還有網(wǎng)友表示,最近是咋滴啦?!一打開抖音,好像捅了螞蟻窩。

溫馨提示:聽音樂讀本文,效果更佳哦!

Dragostea Din TeiO-Zone - Disco-Zone (+3 Bonus)

大家一起《螞蟻呀嘿》!

這款A(yù)I特效,只需要一張照片,就可以火速讓anyone“螞蟻呀嘿”。

正因?yàn)檫@么便捷,果不其然,馬上成為了抖音網(wǎng)友們的“新寵”。

各路名人開始搞起!

首先登場的是四大天王:劉德華、張學(xué)友、郭富城和黎明!

或許天王們太久沒有同框過了,網(wǎng)友們用這種方式將他們“召集”在一起,也是別有一番風(fēng)味。

“永不過時(shí)”的《還珠格格》,也趕上了這趟潮流列車。

王者峽谷里的英雄們,網(wǎng)友們也是沒有放過。

不得不感慨二次元的顏值,不論怎么惡搞、變形,還是能保持俊美的樣子(程咬金除外)。

除了上面這種九宮格模式外,高端的操作還可以實(shí)現(xiàn)集體同框。

于是,“愛玩”的德云社就以這種方式亮相了。

不知道是不是因?yàn)樘匦^逼真、還是脖子有點(diǎn)短(不是),竟然還有人以為是真的。

第一眼我以為是特效。

當(dāng)然,此等名場面,怎么少得了量子位本位!集體《螞蟻呀嘿》表演,隆重登場!

OK,各種效果、各種玩法已經(jīng)展示完畢。

接下來,是時(shí)候上手實(shí)操了!

如何制作專屬的“螞蟻呀嘿”?

首先需要準(zhǔn)備三個(gè)工具:

Avatarify、任意一款加速器APP、剪映(可有可無)。

第一步,打開加速器,啟動加速模式。

第二步,打開這款軟件Avatarify,選擇一張照片即可進(jìn)入選擇特效頁面(臉正一點(diǎn)食用效果更佳)。

然后向下拉,找到布拉德·皮特的特效即可。

是不是很簡單?

不過有點(diǎn)遺憾的是,暫時(shí)只有蘋果手機(jī)才OK(安卓用戶淚目)。

一個(gè)人演唱“螞蟻呀嘿”的效果就已經(jīng)實(shí)現(xiàn)了。

如果想要多人演唱、九宮格那樣式兒的,那就需要剪映來加持了,這里就不詳細(xì)展開了。

當(dāng)然,這款軟件除了《螞蟻呀嘿》之外,還有很多模板可選。

例如,李開復(fù)老師便友情上演了一首《Only You》。

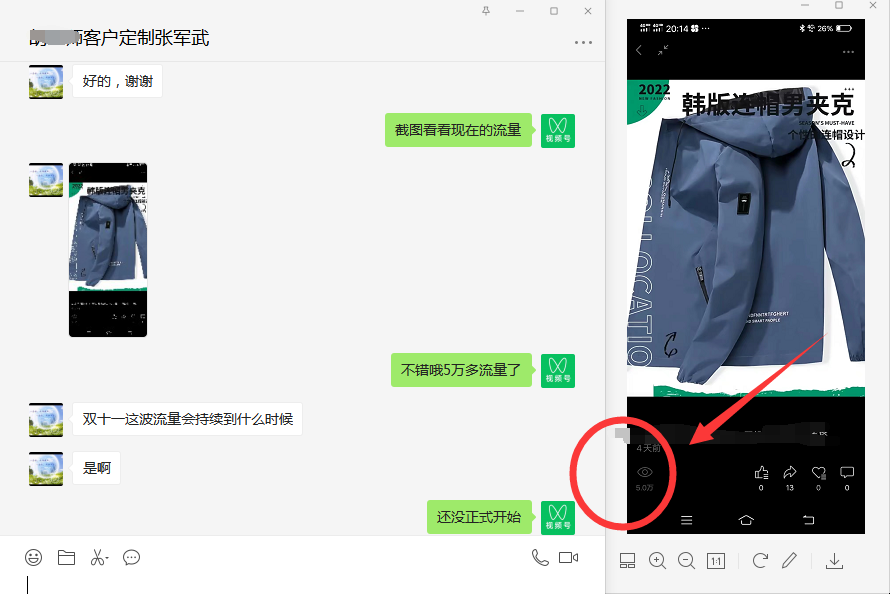

隨著這波潮流,Avatarify及其他相關(guān)軟件,已經(jīng)超過微信、拼多多、抖音的下載量,登頂蘋果App Store免費(fèi)榜“前三甲”!

什么原理?

那么問題來了。

AI,是如何搞定各位大佬來唱歌的呢?

讓一張照片動起來,人臉跟著音樂一起擠眉弄眼,需要一個(gè)叫做一階運(yùn)動模型 (First Order Motion Model)來搞定。

技術(shù)原理借鑒了去年意大利特倫托大學(xué)的一項(xiàng)研究,入選了NIPS 2019。

當(dāng)時(shí)的例子是這樣的。

以川建國同志為參考,來自《冰與火之歌》的演員照片瞬間做到了神同步。

不光是臉動,一個(gè)模特?fù)Qpose、奔騰的馬也都不在話下。

模型框架主要由2部分構(gòu)成,運(yùn)動估計(jì)模塊和圖像生成模塊。

運(yùn)動估計(jì)模塊的目的,是預(yù)測一個(gè)密集的運(yùn)動場。研究人員假設(shè)存在一個(gè)抽象的參考框架,并且獨(dú)立估計(jì)兩個(gè)變換,分別是「從參考到源」和「從參考到驅(qū)動」,這樣就能夠獨(dú)立處理源幀和驅(qū)動幀。

而這兩種變換,通過使用以自監(jiān)督方式學(xué)習(xí)的關(guān)鍵點(diǎn)來獲得。利用局部仿射變換對每個(gè)關(guān)鍵點(diǎn)附近的運(yùn)動進(jìn)行建模。

隨后,密集運(yùn)動網(wǎng)絡(luò)結(jié)合局部近似得到密集運(yùn)動場。

這個(gè)網(wǎng)絡(luò)還能輸出遮擋的mask,指示哪些圖像的驅(qū)動部分可以通過源圖像的扭曲(warping)來重建,哪些部分應(yīng)該被繪制(根據(jù)上下文推斷)。

在生成模塊按照驅(qū)動視頻中,提供的源對象移動的圖像進(jìn)行渲染。

此處,研究人員還使用一個(gè)生成器網(wǎng)絡(luò),根據(jù)密集的運(yùn)動對源圖像進(jìn)行扭曲,并對源圖像中被遮擋的圖像部分進(jìn)行著色。

訓(xùn)練階段,研究人員采用了大量的視頻序列集合來訓(xùn)練模型,這當(dāng)中包含了相同類別的對象。

隨后在測試階段,研究人員將模型應(yīng)用于由源圖像和驅(qū)動視頻的每一幀組成的對,并執(zhí)行源對象的圖像動畫。

最終在質(zhì)量評估中,這一方法在所有基準(zhǔn)上都明顯優(yōu)于當(dāng)前先進(jìn)技術(shù)。

此前類似研究也很火爆

這種AI特效能夠如此火爆,甚至“破圈”,讓大家玩得不亦樂乎,最主要的原因是方便——不需要任何編程知識,便可完成。

但在此之前,其實(shí)這種AI特效在圈里也是有火過,但都需要一定的計(jì)算機(jī)能力才可以實(shí)現(xiàn)。

比如,一張名人照片和一個(gè)你說話的視頻,就可以讓夢露學(xué)你說話。

還有,印度程序員開發(fā)的實(shí)時(shí)動畫特效。你一動,蒙娜麗莎跟著你一起動~

那么現(xiàn)在,你被“螞蟻呀嘿”洗腦了嗎?

快去體驗(yàn)下吧。

參考鏈接:

[1] https://avatarify.ai/

[2] https://github.com/AliaksandrSiarohin/first-order-model

關(guān)鍵詞: 特效 火爆 網(wǎng)絡(luò) 各路